- 品牌

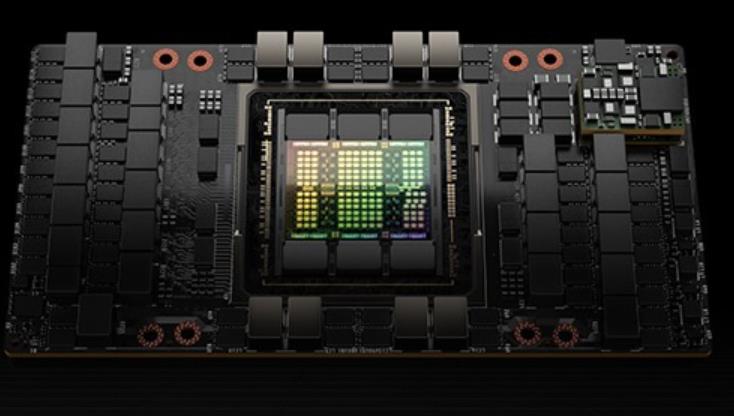

- Nvidia

- 型号

- H100

- 磁盘阵列

- Raid10

- CPU类型

- Intel Platinum 8558 48 核

- CPU主频

- 2.10

- 内存类型

- 64G

- 硬盘容量

- Samsung PM9A3 7.6TB NVMe *8

- 厂家

- SuperMicro

- 标配CPU个数

- 2个

- 最大CPU个数

- 4个

- 内存容量

- 64G*32

- GPU

- 8 H100 80GB NVlink

L2CacheHBM3内存控制器GH100GPU的完整实现8GPUs9TPCs/GPU(共72TPCs)2SMs/TPC(共144SMs)128FP32CUDA/SM4个第四代张量/SM6HBM3/HBM2e堆栈,12个512位内存控制器60MBL2Cache第四代NVLink和PCIeGen5H100SM架构引入FP8新的Transformer引擎新的DPX指令H100张量架构专门用于矩阵乘和累加(MMA)数学运算的高性能计算,为AI和HPC应用提供了开创性的性能。H100中新的第四代TensorCore架构提供了每SM的原始稠密和稀疏矩阵数学吞吐量的两倍支持FP8、FP16、BF16、TF32、FP64、INT8等MMA数据类型。新的TensorCores还具有更**的数据管理,节省了高达30%的操作数交付能力。FP8数据格式与FP16相比,FP8的数据存储需求减半,吞吐量提高一倍。新的TransformerEngine(在下面的章节中进行阐述)同时使用FP8和FP16两种精度,以减少内存占用和提高性能,同时对大型语言和其他模型仍然保持精度。用于加速动态规划(“DynamicProgramming”)的DPX指令新引入的DPX指令为许多DP算法的内循环提供了高等融合操作数的支持,使得动态规划算法的性能相比于AmpereGPU高提升了7倍。L1数据cache和共享内存结合将L1数据cache和共享内存功能合并到单个内存块中简化了编程。H100 GPU 的带宽高达 1.6 TB/s。CPUH100GPU优惠

ITMALL.sale 拥有丰富的行业经验和专业的技术团队,能够为客户提供专业的 H100 GPU 咨询和技术支持。ITMALL.sale 深知每个客户的需求都是独特的,因此在销售过程中注重与客户的沟通,了解其具体需求,提供量身定制的解决方案。ITMALL.sale 的技术团队能够帮助客户快速部署和优化 H100 GPU 系统,确保其能够充分发挥 H100 GPU 的强大性能,为客户的业务发展提供强有力的支持。

ITMALL.sale 拥有完善的供应链和物流体系,确保客户能够快速、便捷地获得 H100 GPU 产品。ITMALL.sale 与多家物流公司合作,能够提供灵活的配送服务,满足不同客户的配送需求。无论是大批量采购还是小批量订购,ITMALL.sale 都能够确保产品及时送达。ITMALL.sale 的仓储和物流团队经过专业培训,能够高效、安全地处理每一笔订单,确保产品在运输过程中完好无损地送到客户手中。 CPUH100GPU优惠H100 GPU 降价特惠,赶快抢购。

H100 GPU 还集成了多种先进的安全和管理功能。例如,它支持 NVIDIA 的 GPU Direct 技术,能够实现 GPU 之间的直接通信,减少了 CPU 参与的数据传输延迟,提升了数据传输效率。此外,H100 GPU 还支持多种虚拟化技术,如 NVIDIA vGPU,能够在虚拟化环境中提供高性能的图形和计算服务。其多样化的管理和安全功能,使得 H100 GPU 在企业级数据中心和云计算平台中具备了更高的适用性和管理便捷性。在能效方面,H100 GPU 也表现优异。其功耗设计为 400W,但在实际使用中,通过优化负载分配和动态电压频率调节(DVFS)技术,可以有效降低功耗,提高能效比。对于需要长时间运行的大规模计算任务,H100 GPU 的高能效设计不仅可以降低运营成本,还减少了对环境的影响。其先进的功耗管理技术确保了在提供高性能计算的同时,依然能够保持较低的能源消耗。

对于科学计算而言,H100 GPU 提供了强大的计算能力。它能够高效处候模拟、基因组学研究、天体物理学计算等复杂的科学任务。H100 GPU 的大规模并行处理单元和高带宽内存可以提升计算效率和精度,使科学家能够更快地获得研究成果。其稳定性和可靠性也为长时间计算任务提供了坚实保障,是科学计算领域不可或缺的工具。H100 GPU 的高能效设计不仅提升了性能,还为科研机构节省了大量的能源成本。其灵活的扩展性和兼容性使得科学计算能够根据需要进行调整和优化,从而更好地支持前沿科学研究和创新发现。H100 GPU 降价热卖,不要错过。

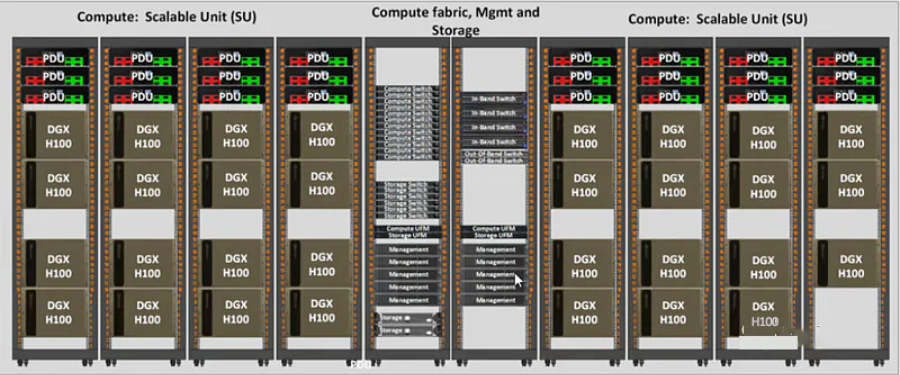

他们与英伟达合作托管了一个基于NVIDIA的集群。Nvidia也是Azure的客户。哪个大云拥有好的网络?#Azure,CoreWeave和Lambda都使用InfiniBand。Oracle具有良好的网络,它是3200Gbps,但它是以太网而不是InfiniBand,对于高参数计数LLM训练等用例,InfiniBand可能比IB慢15-20%左右。AWS和GCP的网络就没有那么好了。企业使用哪些大云?#在一个大约15家企业的私有数据点中,所有15家都是AWS,GCP或Azure,零甲骨文。大多数企业将坚持使用现有的云。绝望的初创公司会去哪里,哪里就有供应。DGXCloud怎么样,英伟达正在与谁合作?#“NVIDIA正在与的云服务提供商合作托管DGX云基础设施,从Oracle云基础设施(OCI)开始”-您处理Nvidia的销售,但您通过现有的云提供商租用它(首先使用Oracle启动,然后是Azure,然后是GoogleCloud,而不是使用AWS启动)3233Jensen在上一次财报电话会议上表示:“理想的组合是10%的NvidiaDGX云和90%的CSP云。大云什么时候推出他们的H100预览?#CoreWeave是个。34英伟达给了他们较早的分配,大概是为了帮助加强大型云之间的竞争(因为英伟达是投资者)。Azure于13月100日宣布H<>可供预览。35甲骨文于21月100日宣布H<>数量有限。H100 GPU 优惠促销,立刻购买。NVLINKH100GPU

H100 GPU 特价出售,数量有限。CPUH100GPU优惠

使用张量维度和块坐标来定义数据传输,而不是每个元素寻址。TMA操作是异步的,利用了基于共享内存的异步屏障。TMA编程模型是单线程的,选择一个经线程中的单个线程发出一个异步TMA操作(cuda::memcpy_async)来复制一个张量,随后多个线程可以在一个cuda::barrier上等待完成数据传输。H100SM增加了硬件来加速这些异步屏障等待操作。TMA的一个主要***是它可以使线程自由地执行其他的工作。在Hopper上,TMA包揽一切。单个线程在启动TMA之前创建一个副本描述符,从那时起地址生成和数据移动在硬件中处理。TMA提供了一个简单得多的编程模型,因为它在复制张量的片段时承担了计算步幅、偏移量和边界计算的任务。异步事务屏障(“AsynchronousTransactionBarrier”)异步屏障:-将同步过程分为两步。①线程在生成其共享数据的一部分时发出"到达"的信号。这个"到达"是非阻塞的。因此线程可以自由地执行其他的工作。②终线程需要其他所有线程产生的数据。在这一点上,他们做一个"等待",直到每个线程都有"抵达"的信号。-***是允许提前到达的线程在等待时执行的工作。-等待的线程会在共享内存中的屏障对象上自转(spin)。CPUH100GPU优惠

- 80GH100GPU现货 2025-02-26

- 模组H100GPU现货 2025-02-25

- xfusionH100GPU库存 2025-02-25

- 套装H100GPU货期 2025-02-24

- Singapore80GH100GPU 2025-02-24

- 香港H100GPU www.itmall.sale 2025-02-21

- 重庆H100GPU优惠 2025-02-20

- 深圳H100GPU一台多少钱 2025-02-19

- 香港H100GPU折扣 2025-02-14

- 香港H100GPU多少钱 2025-02-14

- 河南NVLINKH100GPU 2025-02-11

- TaiwanH100GPU优惠 2025-02-10